- Answer 3

- 세계 최초의 성과!

거대 생성 모델의 경량화 해법을 찾다

본문영역

세계 최초의 성과!

거대 생성 모델의 경량화 해법을 찾다

인공지능대학원 유재준 교수

전 세계적 열풍을 몰고 온 챗GPT 같은 거대 생성 모델은 쉽게 접근하기 어려울 만큼 대량의 데이터와 계산 자원을 필요로 한다. 유재준 교수는 최근 연구를 통해 이에 대한 해법을 제시했다. 생성 모델 내에서 강력한 서브네트워크의 존재를 밝힌 것이다. 이를 통해 생성 모델의 경량화 연구의 가능성을 열어 보였다.

생성형 AI, 비싸고 전력 소모 많아

세상에 첫선을 보이자마자 전 세계에서 가장 뜨거운 단어가 된 ‘챗GPT’에 대한 열광이 식지 않고 있다. 하지만 챗GPT 같은 거대 생성 모델의 이면에는 불편한 진실이 숨어 있다. 바로 방대한 데이터를 학습하고 추론하기 위해서는 그만큼 많은 에너지가 요구된다는 것이다. 이는 막대한 탄소를 배출한다는 의미인데, 문제는 갈수록 생성형 AI의 활용처가 늘어날 것이라는 점이다.

“현재 사용되고 있는 GPT의 기본 요소인 트랜스포머(Transformer) 모델의 경우, 실제 GPT 수준에서 약 1만 배 작은 모델을 한 번 학습하려면 5대의 자동차가 평생 배출할 용량의 탄소를 배출한다고 합니다. 게다가 대규모 투자비가 들기 때문에 챗GPT 수준의 거대 모델을 연구 및 개발할 수 있는 기업은 세계적으로도 열 손가락 안에 꼽습니다. 지금처럼 많은 자원을 들여 거대 모델을 학습하거나 연구하는 것은 지속가능하지 않다고 생각했습니다.”

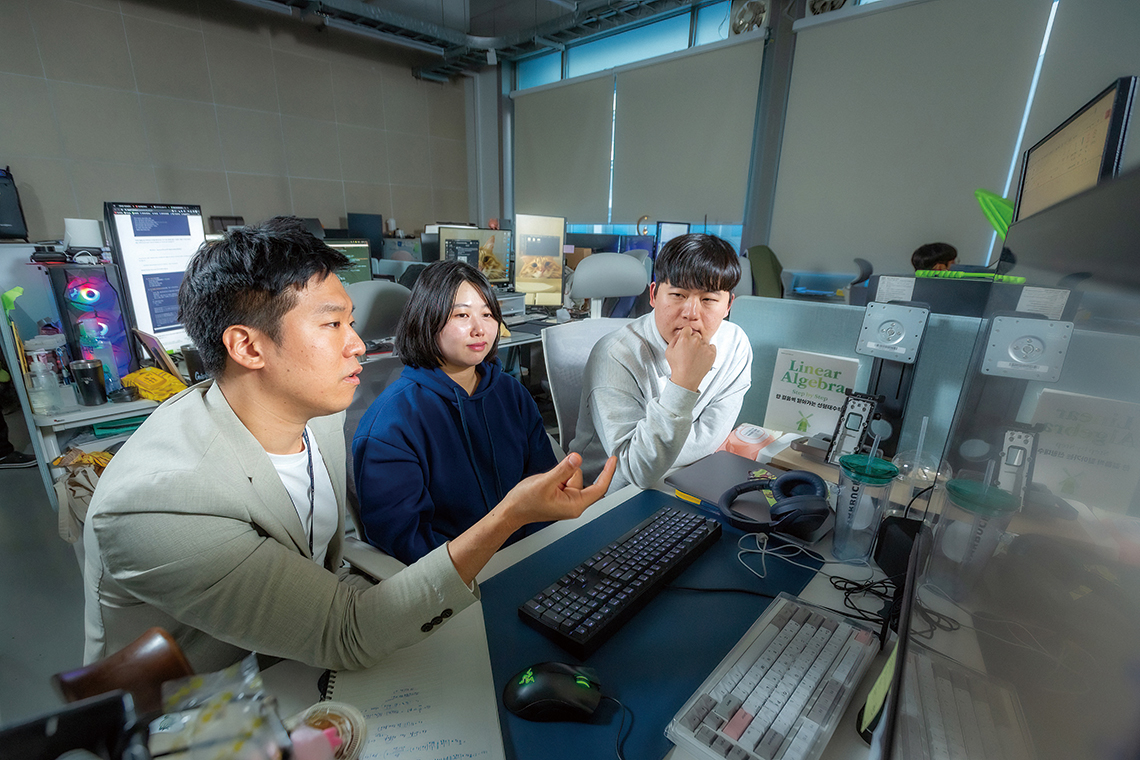

유재준 교수는 2018년부터 2019년까지 2년간 ‘네이버’에서 AI 연구원으로 일하며 생성 모델 연구팀을 이끌었다. 아직 챗GPT 수준의 거대 모델이 세상에 나오기 전이었기는 했지만, 당시만 해도 컴퓨팅 자원의 크기 등은 신경 쓰지 않고 연구에 임할 수 있었다. 하지만 개인 연구자가 되니 대량의 데이터와 계산 자원이 필요한 거대 생성 모델 연구는 접근하기 어려웠다. 그래서 모델의 성능은 유지하되 좀 더 효율적인 학습방법을 개발하거나 모델 자체를 경량화하는 방법, 혹은 아예 다른 프레임워크로 혁신하는 방안을 모색하게 됐다. 그러다 주목하게 된 것이 생성 모델의 경량화였다. 사실 경량화 분야는 유재준 교수의 주력 연구 분야는 아니었다.

“잘 아는 분야가 아니기 때문에 방법을 찾던 중 학과에서 진행한 온라인 세미나의 연사 중 한 분이 분류 모델의 경량화 연구를 하는 분이라는 것을 알게 됐습니다. 그래서 적극적으로 연락을 취해 함께 협력 연구를 진행하게 됐습니다.”

생성 모델의 경량화 가능성 시사

유재준 교수팀은 이번 연구를 통해 추가 학습 없이도 원 모델과 유사하거나 더 나은 성능을 보이는 강력한 서브네트워크(strong lottery ticket)가 생성 모델에서도 존재한다는 사실을 세계 최초로 밝혀냈다. 이는 원 생성 모델의 10%에 해당하는 파라미터만 사용하면서도 원 모델만큼의 성능을 발휘한다.

“기존의 대다수 경량화 방법은 모델 크기를 줄이는 대신 성능을 떨어뜨리는 문제가 있었습니다. 보통 경량화 알고리즘들은 큰 틀에서 어떤 정량적인 학습 성능 기준을 바탕으로 이를 유지하면서 여기에 끼치는 영향이 적은 파라미터를 없애는 방식입니다.”

분류 모델의 경량화는 이러한 방법으로 충분히 해법을 찾을 수 있다. 하지만 생성 모델은 생성된 데이터에 대한 평가 기준이 생성이라는 분야의 특성상 주관적이기 때문에 정량화가 어렵다. 생성 모델들의 학습 자체도 매우 불안정한데 파라미터까지 없애면 불안정성이 심화할 수 있다. 따라서 생성 모델의 경량화 연구는 난도가 매우 높아 활발하지 않은 실정이다. 그렇지만 유재준 교수는 도전을 주저하지 않았다. 사회에 꼭 필요한 연구이고, 못 할 것도 없는 연구라고 생각한 것이다.

“대학의 연구자는 기업이 도전하지 못하는 분야를 연구해야 한다고 생각합니다. 생성 모델의 경량화를 이루면 산업체에도 도움을 줘 기업들이 서비스를 더욱 발전시킬 수 있을 것입니다. 그리고 어렵다고는 하지만 방법을 고민하면 찾을 수 있죠. 실패해도 괜찮다는 생각으로 연구를 시작했습니다.”

유재준 교수 연구팀이 개발한 강력한 서브네트워크 방식은 생성 성능은 동등하거나 심지어 우월한데 가벼운 모델을 안정적으로 찾을 수 있는 방법이라는 데 의의가 있다. 또한 강력한 서브네트워크를 찾는 알고리즘도 제안해 3대 인공지능학회 중 하나인 AAAI에 발표하고, 국내 특허 출원에 이어 국제 특허 출원도 진행 중이다.

“본 연구는 생성 모델 경량화 연구의 가능성을 보여줬습니다. 이를 계기로 관련 연구들이 활발하게 촉진되는 시발점이 되기를 바랍니다.”

자신만의 전문성 키우는 것이 AI 시대의 인재

앞서 언급했듯이 전 세계적으로 거대 생성 모델을 연구하고 서비스할 수 있는 기업은 얼마 되지 않는다.

“대부분 미국 기업인데, 우리나라의 네이버가 글로벌 스탠다드에 버금가는 모델을 보유하고 실제 서비스를 하고 있습니다. 이것만 봐도 우리나라의 경쟁력을 알 수 있죠. 이는 비단 기업의 경쟁력뿐 아니라 학계의 저력을 보여주는 것이라고 생각합니다. 주요 AI학회에 발표되는 논문의 양만 봐도 우리나라가 미국, 중국과 함께 선두를 달리고 있습니다.”

유재준 교수 또한 앞으로도 산업과 사회의 발전에 이바지하면서 학계에서만 할 수 있는 연구 주제들을 계속 고민할 것이다. 이를테면 패러다임을 전환할 새로운 방식의 생성 모델을 개발하는 것이다.

“재미있게도, 그리고 어쩌면 당연하게도 생성 모델에서 패러다임을 바꿨던 모델들은 항상 기업이 아니라 학계에서 나왔습니다. 2014년에 발표돼 지금도 꾸준히 연구되고 있는 GAN이라는 모델도 그렇고, 이를 대체해 현재 영상 생성 모델이라면 모두 사용하고 있는 확산(Diffusion) 모델도 학계에서 나왔습니다. 분명 이게 끝이 아닐 테니 새로운 방식의 생성 모델을 최초로 개발하는 연구자가 되고 싶습니다.”

인터뷰 말미, 유재준 교수는 인공지능 시대의 인재가 될 UNIST인을 위해 조언을 남겼다. 인공지능 역시 사람이 주체가 돼 사람을 위해 사용할 도구이기에 이를 잘 활용하고 소통할 수 있는 능력을 갖추는 것이 중요하다고 강조했다.

“대학과 대학원에서 배우는 것들을 나열하자면 한없이 많겠지만, 큰 틀에서 보자면 이들은 모두 잘 읽고, 잘 쓰고, 잘 생각하고, 잘 소통하는 법에 해당합니다. 교수로서의 제 역할은 학생들이 이런 소양을 기를 수 있도록 정답이 아닌 좋은 예시를 보여주고, 이를 통해 학생들이 문제를 찾고 정의하고 풀어가는 과정을 도우며, 스스로 더 깊게 더 잘 생각할 수 있도록 이끄는 것입니다. 본인의 위치에서 자신만의 전문성과 혜안을 키우는 것이 인공지능 시대의 핵심 인재로 성장하는 옳은 방법이라 생각합니다.”